Les algorithmes génératifs choisissent à votre place le contenu que vous allez voir, mais ils servent aussi à générer directement de la désinformation. Point de vigilance.

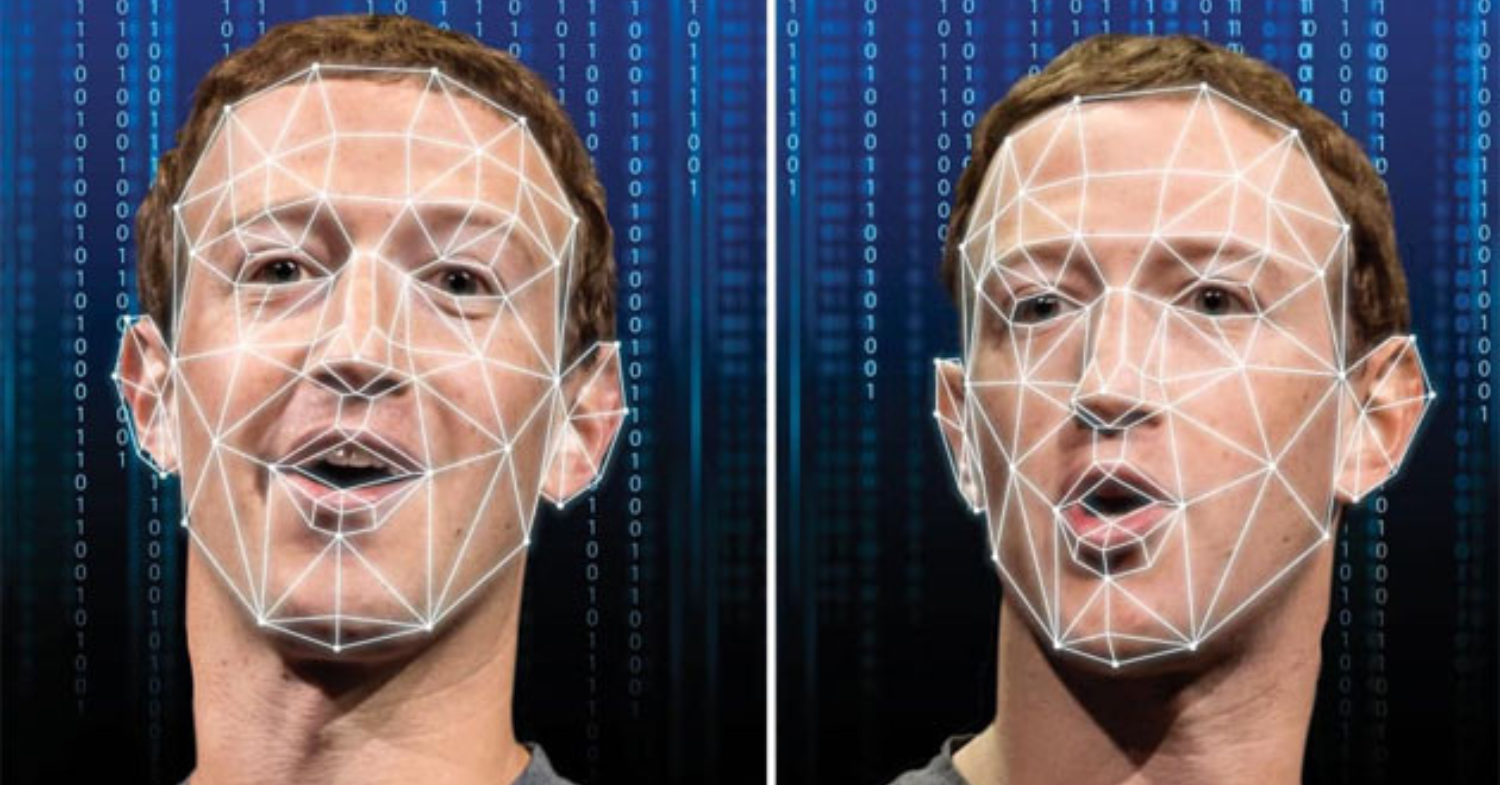

Avant les boomerstraps, il y avait déjà les deepfakes. Des d’anglicismes pour parler des dérives de l’Intelligence artificielle, souvent sous forme de fausses vidéos à caractères politiques.

Discours d’Emmanuel Macron annonçant sa démission, deepfake de l’ex-président américain Joe Biden conseillant aux électeurs de ne pas voter, ou faux comptes d’influenceurs… Le champ des possibles de ce nouvel outil n’est pas seulement fascinant, c’est une véritable menace à l’intégrité de l’information, déjà mise à mal par le monopole des médias par une poignée de milliardaires.

Les algorithmes génératifs : bras armé de la désinformation ?

« Ce n’est pas de la science-fiction, ça se passe en ce moment«

« Ce n’est pas de la science-fiction, ça se passe en ce moment« , prévient Lê Nguyên Hoang, spécialiste en éthique des Intelligences Artificielles (IA) dans une tribune pour TV5 monde.

L’Intelligence artificielle a fait exploser la capacité de manipulation de l’opinion publique, non seulement à travers les deepfakes de leaders politiques qu’on ne compte plus, mais aussi à travers le business juteux des faux comptes d’influenceurs, comme l’influenceuse virtuelle Lil Miquela sur Instagram et le compte TikTok d’Amandine Le Pen, une fausse nièce de Marine Le Pen.

Donald Trump, ouvrant toujours plus large la fenêtre d’Overton du populisme et du fascisme, est allé jusqu’à utiliser lui-même des images générées par IA de Taylor Swift et de ses fans à des fins politiques.

“Soyons rationnel, il faut croire en l’IA”

Il n’est pas rare d’entendre cette phrase au détour d’une conversation. Elle met en avant les mérites de l’IA dans le progrès et l’évolution de la civilisation humaine, comme dans la nouvelle de l’auteur de Science-Fiction Isaac Asimov La machine qui gagna la guerre, où toute décision et vérité sont émises par la superintelligence Multivac. Un moyen fantasmé d’atteindre le paroxysme de la servitude volontaire, concept de La Boétie décrivant notre tendance paradoxale à céder nos droits et pouvoirs à autrui – ici la machine – pour éviter le fardeau des choix politiques, au prix de notre liberté.

« 1,254 sites d’information et d’actualité générés par l’IA et gérés avec peu voire pas de supervision humaine »

En pratique toutefois, concéder notre confiance aveuglément est hautement risqué : une enquête de Newsguard a identifié à ce jour 1,254 sites d’information et d’actualité générés par l’IA et gérés avec peu voire pas de supervision humaine, incluant ainsi plus facilement de fausses informations.

L’IA ment mieux que l’humain

Pire, en plus d’être propice à faire circuler des fakenews de façon rapide et étendue, l’IA le fait plus efficacement que l’être humain. Une étude de l’Université de Zurich a montré que les faux tweets générés par GPT-3 étaient plus susceptibles d’être crus que ceux rédigés par des humains. Les participants étaient ainsi 3 % moins enclins à croire les faux tweets rédigés par des humains que ceux générés par GPT-328.

Les tweets contenant de fausses informations générés par GPT-3 étaient plus efficaces pour tromper les lecteurs que les tweets organiques contenant de la désinformation et les humains ne pouvaient pas distinguer de manière fiable entre les tweets créés par GPT-3 et ceux écrits par de vrais utilisateurs de Twitter, un peu comme un test de Turing inversé.

Et les géants de l’IA s’y sont mis à fond, créant des réseaux antagonistes génératifs (GAN), développés initialement par Ian Goodfellow, et permettant aujourd’hui de produire des deepfakes d’un réalisme saisissant. Ces vidéos truquées inondent les réseaux sociaux à une vitesse alarmante. L’exemple du deepfake de Barack Obama en 2018 déjà, visionné près de 3 millions de fois, illustre le potentiel destructeur de cette technologie.

IA génératives : guerre froide 3.0 ?

Évidemment, le conflit États-Unis-Russie-Chine vient ternir ce tableau déjà bien sombre : Le groupe russe Doppelganger, par exemple, déploie des techniques d’obscurcissement de texte pour contourner les systèmes de détection des deepfake utilisé par les réseaux sociaux. Or, comme l’affirme l’AFP, l’utilisation de l’IA dans les campagnes de propagande politique permet de produire un grand volume de contenu rapidement et de manière convaincante, rendant la désinformation plus difficile à détecter et à contrer.

L’IA contre l’IA : fausse bonne idée ?

Alors que les technologies d’IA générative continuent de progresser, la société doit urgemment trouver des moyens de distinguer le vrai du faux dans ce nouveau paysage informationnel. L’éducation aux médias et le développement de solutions technologiques robustes apparaissent plus que jamais comme des priorités pour préserver l’intégrité de notre espace informationnel.

Certains défendent ainsi la thèse suivante : il faut se servir de l’IA comme d’un bouclier high-tech contre la désinformation, avec des algorithmes de pointe, capables de disséquer le langage et de décortiquer les images en millisecondes, redéfinissent les frontières du fact-checking. « Nous assistons à une véritable révolution dans la vérification de l’information« , affirme le Dr. Elena Kovacs, directrice du Centre pour l’Intégrité Numérique, qui ajoute que « l’IA peut désormais détecter des nuances subtiles que l’œil humain pourrait manquer. »

Cependant, cette “avancée” soulève des interrogations. Le professeur Jean-Paul Durand, éthicien des médias, met en garde :

« Si l’IA est un outil puissant, elle ne doit pas remplacer le jugement humain. Le risque de créer une ‘bulle de filtrage’ algorithmique est réel.«

Mais n’y sommes-nous pas déjà, dans cette époque de scission entre les peuples à causes des bulles de filtrage ? Est-on en train de résoudre un problème par un problème ?

Sommet de l’IA : entre besoin de coopération et financements privés !

En attendant, il y a peu se déroulait le sommet de l’Intelligence artificielle du 6 au 11 février 2025 à Paris. À cette occasion d’ailleurs, le besoin d’une technologie plus frugale a été largement occulté. Pourtant, c’est également un enjeu majeur, puisque « Les centres de données (data centers) liés à l’IA et aux crypto-monnaies ont consommé près de 460 TWh (460×1012 Wh) d’électricité en 2022, soit environ 2% de la production mondiale. De nombreux experts s’accordent à dire que ce pourcentage aura vraisemblablement doublé d’ici 2026 ».

Tandis que Macron y présentait sa dernière levée de fonds “pour des projets de développement de l’IA ” : 109 milliards d’euros d’investissements, essentiellement étrangers – avec comme investisseurs l’Arabie saoudite – une table ronde spécifique a été consacrée à l’utilisation de l’IA pour “protéger les démocraties contre les cyberattaques et la manipulation de l’information”.

La CNIL (Commission Nationale de l’Informatique et des Libertés) a participé activement au sommet pour promouvoir une IA respectueuse des droits fondamentaux, en mettant l’accent sur la transparence et la protection des données.

“Les Big Tech [ndlr : les géants de la tech ou GAFAM] ont une grosse responsabilité sur ces sujets «

souligne la présidente du CNIL, Marie-Laure Denis, dont l’institution a publié en avril ses premières recommandations sur l’IA. Ces entreprises doivent être particulièrement transparentes au sujet des données qu’elles utilisent afin que les utilisateurs puissent avoir confiance.”

Sans surprise, le sommet a également exploré l’utilisation de l’IA elle-même comme outil de lutte contre la désinformation, notamment pour la détection automatisée des faux contenus et le fact-checking automatisé. L’importance de l’éducation aux médias et de la sensibilisation du public aux risques de la désinformation a été soulignée, mais rien de concret n’a été avancé.

Edgars Rinkevics, le président de la Lettonie, rappelle l’enjeu premier de cette réunion : “ Lors du prochain cycle d’élections, l’IA ne sera pas seulement utilisée pour créer des deepfakes, mais pour analyser des comportements politiques des citoyens.”.

Quant à Meredith Whittaker, présidente de Signal, qui milite pour les technologies open source, elle prend le contre-pied en demandant qui, dans la salle, a entendu parler de Recall, un programme développé par Microsoft, permettant de mémoriser l’activité d’un appareil en prenant des captures d’écran toutes les cinq secondes. Seules quelques mains se lèvent.

“ Nous avons désespérément besoin de davantage de coopération sur l’IA, assure Mathias Cormann, secrétaire général de l’OCDE, qui a lancé une plateforme sur le sujet. Nous faisons face chaque jour à de nouveaux risques, les gouvernements doivent travailler avec des plateformes de confiance, qui ont la connaissance de ces sujets, et nous avons besoin d’une gouvernance globale et cohérente qui cessent de nier le droit citoyen à une information rigoureuse.

À défaut d’en être là, et pendant que de grands journaux licencient leur rédaction au profit de l’IA, de nombreux médias indépendants (comme ici chez Mr Mondialisation) affirment des positions fortes et des lignes éditoriales de plus en plus claires contre l’usage de cet outil dans leur contenu journalistique, permettant a minima à l’internaute de s’abonner à un flux plus fiable d’information.

– Maureen Damman

Image d’entête @Budiey/Flickr