Entre deepfakes, boomers traps et désinformations, les IA peuvent influencer des campagnes électorales, comme celle de Donald Trump sur X, de Jordan Bardella sur Tiktok, ou des conflits armés, comme la fausse vidéo du président ukrainien Zelensky appelant à la reddition. Mais au lieu de subir, ne devrait-on pas plutôt se servir de l’IA contre le système, afin de promouvoir de vraies démocraties ?

« Quand c’est gratuit, c’est que c’est toi le produit ». Sur les milliards d’heures de vidéos consommées chaque jour, 70 % proviennent de recommandations par IA (Intelligence Artificielle), qui peut fortement influencer notre quotidien, jusqu’à nos idées politiques et in fine, notre système démocratique. Et si on inversait la tendance en se servant de l’IA contre le système ?

Les IA de recommandations : un danger civilisationnel ?

Entre 2017 et 2018, des milliers de Rohingyas, musulmans de l’ouest de la Birmanie, sont massacrés par les militaires birmans et par des nationalistes bouddhistes. Une étude publiée par Amnesty International montre que Facebook est mis en cause dans la prolifération de la haine anti-rohingya et que les IA du réseau social, chargées de démontrer quels contenus de la plateforme montrer aux utilisateurs, ont activement participé à la haine.

C’est un exemple parmi tant d’autres qui montre bien le danger que posent les IA de recommandations. En témoigne l’ingérence électorale de certains réseaux sociaux au sujet de l’accès au pouvoir de Donald Trump.

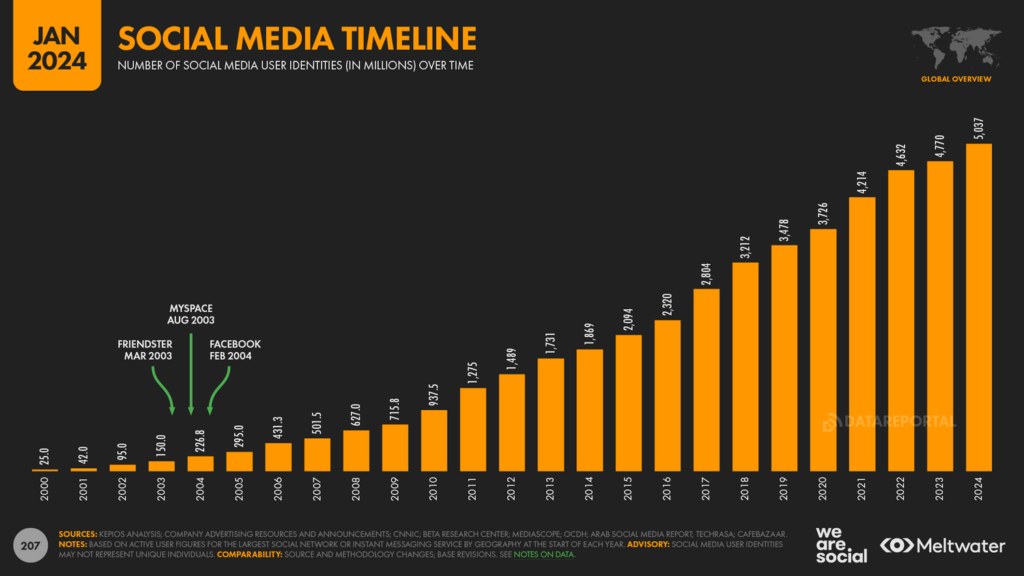

Jean-Lou Fourquet et Lê Nguyên Hoang, auteurs du livre La dictature des algorithmes, affirment qu’en 2016, YouTube recommandait « les clips du fasciste Donald Trump six fois plus que ceux d’Hillary Clinton lors de la campagne ». Tout simplement parce que les clips de Trump sont étudiés pour être sensationnels, attirer le schéma réactionnel primitif que chacun d’entre nous active lors de visionnage de contenu clivant. Plus les contenus sont clivants, plus on a envie de répondre et d’alimenter un débat, plus on passe de temps sur le réseau social, de sorte que d’après les données du Digital 2024: Global Overview Report publié par Statista, les Américains passent en moyenne 7 heures et 4 minutes par jour devant un écran, les français 4,6 selon le Baromètre du numérique 2022.

Quoi de mieux que la colère et la division pour attirer l’attention de l’humain ? Les grandes plateformes le savent bien et suivent le filon en exploitant nos mécanismes cognitifs qui favorisent l’engagement émotionnel intense et instantané au détriment de contenu qui obligerait un effort cognitif supérieur.

Les personnalités politiques se sont emparées de ce piège d’attention : on ne compte plus les tweets et commentaires divers et variés provocateurs des Trump, Zemmour, Macron etc… Le « temps de cerveau disponible » est désormais accaparé par toutes les interfaces numériques, à la manière d’une réalité parallèle qui nous privent littéralement du monde matériel, comme dans l’œuvre magistrale de Hugh Howey, Silo.

Les IA : Diviser pour mieux régner ?

La politique s’en empare, la géopolitique aussi. Selon un article paru dans Libération, en 2016, le gouvernement russe a mené une vaste campagne de désinformation afin de déstabiliser le « bon déroulement » de l’élection présidentielle américaine, en exploitant notamment le mouvement Black Lives Matter.

L’Internet Research Agency (IRA), basée à Saint-Pétersbourg, a créé de faux comptes et groupes sur les réseaux sociaux, se faisant passer pour des militants afro-américains. Leur objectif ? Polariser, diviser, créer des camps ! Les faux comptes publiaient des messages anti-racistes et dénonçaient les violences policières, et créaient aussi parallèlement des groupes pro-policiers, dans le but d’exacerber les tensions raciales. Cette stratégie visait à décourager le vote des Noirs américains et à favoriser l’élection de Donald Trump.

Aujourd’hui, au Royaume-Uni, les régulateurs, les services de sécurité et le gouvernement se battent pour protéger les élections générales contre toute ingérence étrangère malveillante. Pourtant, un usage démocratique de l’IA est possible, sans faire le jeu des puissants.

L’usage démocratique de la technologie

Si l’IA présente des risques importants sur le plan géopolitique ou politique, elle peut laisser entrouvrir des opportunités significatives pour les campagnes. Pour Hannah O’Rourke, cofondatrice de Campaign Lab, un réseau de volontaires technologiques plutôt à gauche, qui organise des cours de formation pour les militants travaillistes et libéraux-démocrates sur l’utilisation de ChatGPT :

« Comme pour toutes les technologies, ce qui compte, c’est la manière dont l’IA est mise en œuvre. Son impact se fera sentir dans la manière dont les militants l’utiliseront. »

Aujourd’hui, difficile pour un citoyen d’exprimer son point de vue, d’attirer l’attention des dirigeants, en dehors des manifestations (quand elles ne sont pas réprimées) ou des pétitions. Et si au lieu de l’algocratie, on misait sur une démocratie algorithmique, pour mettre les IA de notre côté ? La technologie est aussi une connaissance, qui maîtrisée, peut servir au peuple.

La Suisse et Taïwan en avance

En mars 2014, une foule de manifestants envahit le Parlement taïwanais, protestant contre l’accord de libre-échange avec la Chine, qui pèserait lourdement sur l’indépendance économique et politique du pays : c’est la révolution des tournesols ! La première initiative vint de la ministre du digital, Audrey Tang, qui légiféra sur la retransmission en direct des discussions parlementaires dans la rue, véritable fan zone démocratique.

Elle instaure aussi g0v, prononcé gov-zéro, mouvement hacktiviste, visant à remplacer des applications gouvernementales par des alternatives open sources : c’est ainsi que le budget.g0v peut être visualisé de manière claire et dynamique pour toutes et tous. Dans cette même dynamique, elle a désarmé la désinformation en identifiant les contenus trompeurs risquant de devenir viraux, en proposant des corrections avant même qu’ils ne se diffusent, grâce à des memes scientifiques humoristiques.

Quant à la Suisse, elle a développé et testé des systèmes de vote électronique qui utilisent des algorithmes cryptographiques pour assurer la sécurité et la vérifiabilité du processus de vote. Ces algorithmes font partie d’un système plus large qui permet aux citoyens de voter en ligne lors d’élections et de référendums. Attention, le système n’est pas basé sur l’intelligence artificielle, mais sur des protocoles cryptographiques pour sécuriser le processus de vote électronique.

Les initiatives privées

Dans un article de 2019, des chercheurs de l’université Carnegie Mellon ont affirmé ceci : « oui, la gouvernance démocratique d’un grand nombre de décisions complexes est possible ». La solution ? WebuildAI, qui constitue une nouvelle forme de démocratie représentative, dont les représentants ne sont pas des politiciens humains, mais des algorithmes.

Le principe est que chaque électeur humain décrit ses préférences et les inscrit dans un algorithme qui devient son représentant officiel. Ensuite, à chaque fois qu’un dilemme se pose, c’est son représentant algorithmique qui vote à sa place. Cette proposition peut rendre autant enthousiaste qu’horrifié, mais semble convaincre !

Appliqué concrètement dans le contexte d’un algorithme de distribution de dons alimentaires, en collaboration avec l’organisation à but non lucratif 412 Food Rescue, l’algorithme a mis en relation les donateurs avec les bénéficiaires et optimisé les itinéraires de livraison des bénévoles. Les parties prenantes (donateurs, bénéficiaires, bénévoles, personnel) ont participé à la conception de l’algorithme – qui est en no code, aboutissant à une distribution plus équitable et efficace des dons alimentaires.

Chaque électeur peut ainsi concevoir ses propres instructions en décrivant l’algorithme que le don de nourriture devrait suivre. Il crée donc un algorithme très complexe qui va choisir, dans n’importe quel contexte, son bénéficiaire préféré. Pourtant, comment être sûr de la prise de décision éclairée ? L’électeur peut tester son représentant numérique. La mesure et le recul sont pourtant de mise pour le moment, car l’humain est parfois fluctuant dans ses prises de décisions, comme le montre cette étude du CNRS.

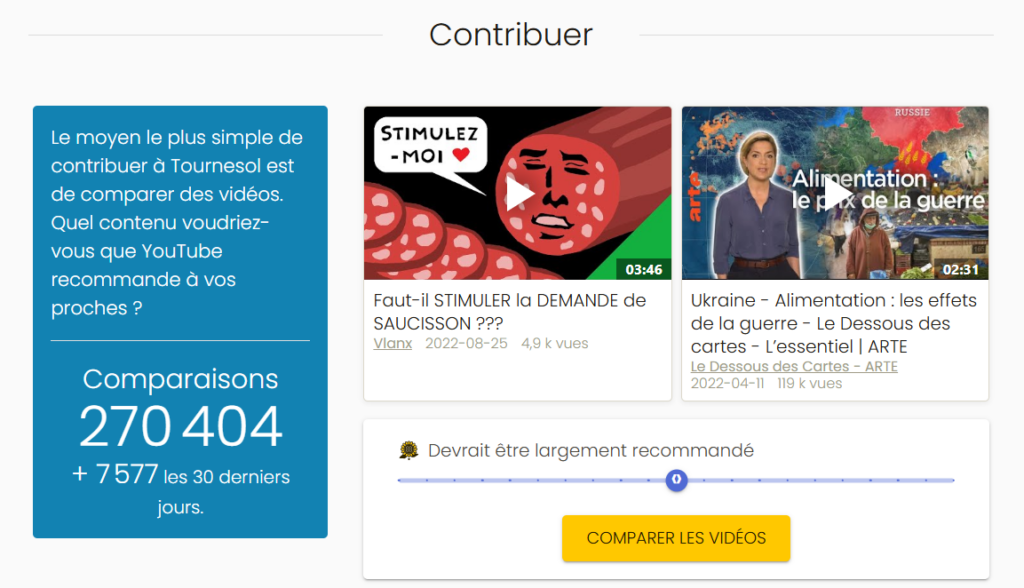

Le projet tournesol

Selon l’Institut international d’études de marché Yougov, alors que 7 consommateurs sur 10 croient que l’IA peut améliorer leurs vies, 88 % d’entre eux exigent plus de transparence de la part des entreprises concernant son utilisation. Le projet Tournesol, initié par Lê Nguyên Hoang, qu’on retrouve dans une vidéo du média Blast, est une plateforme collaborative open-source visant à démocratiser la gouvernance des algorithmes de recommandation.

L’objectif est de contrer le contrôle exercé par les grandes entreprises technologiques et les États autoritaires sur ces systèmes. Le fonctionnement repose sur la participation des utilisateurs qui comparent des vidéos selon des critères d’utilité publique. Ces jugements sont ensuite agrégés pour produire des scores de recommandation éthiques et transparents.

Avec plus de 18 000 utilisateurs ayant évalué près de 24 000 vidéos, Tournesol propose déjà des applications concrètes comme un bot Twitter et des extensions de navigateur. Le projet ambitionne de stimuler la recherche sur des algorithmes de recommandation bénéfiques et une IA éthique, se positionnant comme une alternative aux systèmes actuels qui privilégient l’engagement au détriment de l’utilité publique.

En tout état de cause, cette tension entre potentiel et méfiance souligne l’urgence d’un débat sur l’utilisation éthique et responsable de l’IA dans notre société.

– Maureen Damman

Photo de couverture : Wikimedia